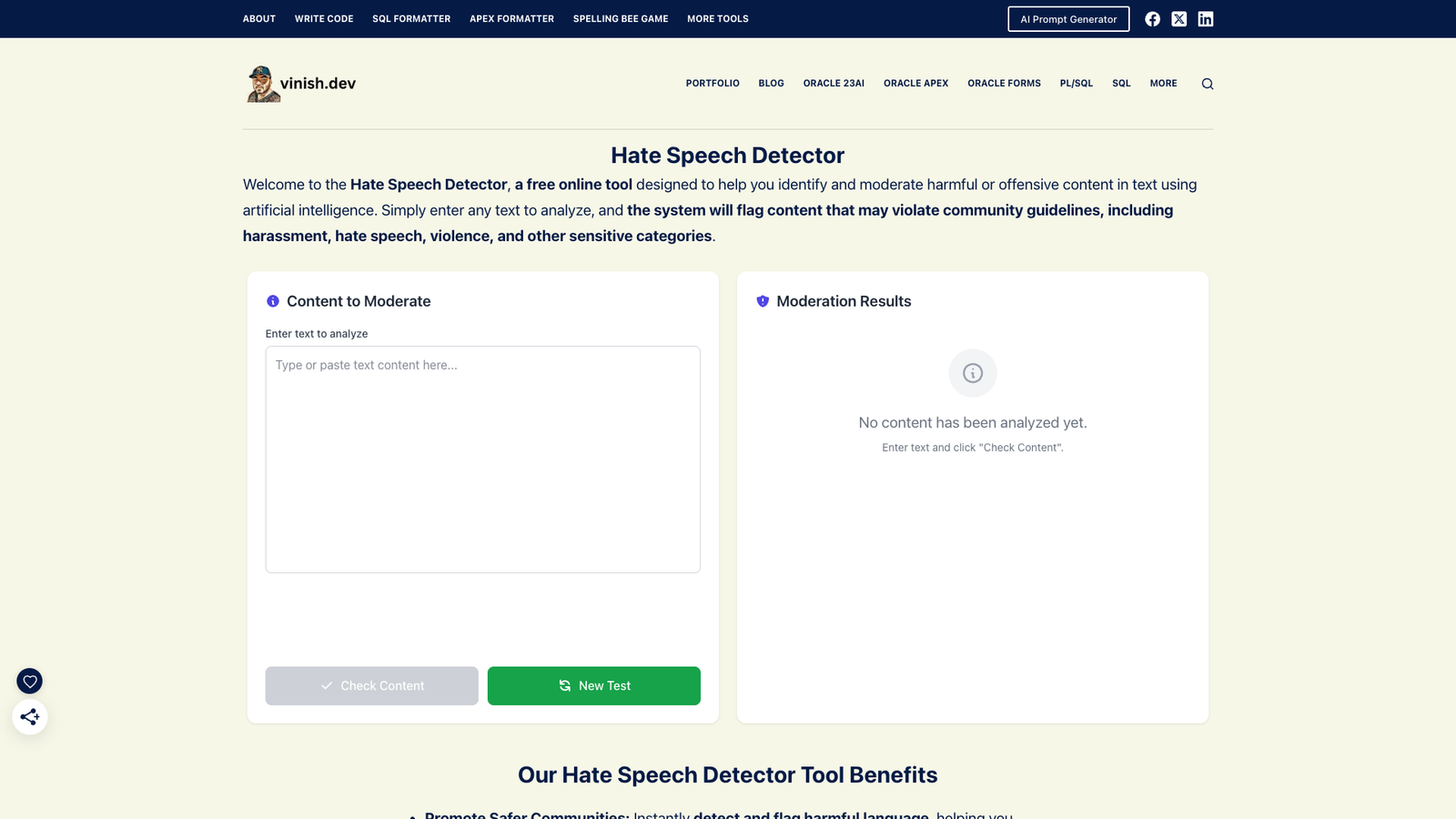

Hate Speech Detector — онлайн-инструмент для быстрой проверки текстов на токсичность, угрозы и враждебные высказывания. Модель ИИ анализирует введённый фрагмент и подсвечивает потенциально опасные формулировки, связанные с ненавистью, дискриминацией или призывами к насилию.

Модерация контента и проверка текстов

Инструмент подходит для ручной модерации комментариев, постов и сообщений. Достаточно вставить текст в поле ввода, чтобы получить оценку риска и понять, какие части могут нарушать правила сообщества или внутренние стандарты компании.

Поддержка безопасной коммуникации

Hate Speech Detector помогает авторам и редакторам заранее находить проблемные формулировки в черновиках. Это снижает вероятность публикации оскорбительного или агрессивного контента и упрощает соблюдение политик безопасности.

Использование ИИ для анализа языка

Система опирается на модели искусственного интеллекта, обученные на примерах токсичных и нейтральных высказываний. Такой подход даёт более гибкую оценку, чем простые фильтры по ключевым словам, и учитывает контекст фраз.