Wan 2.1 — модель ИИ, разработанная компанией Alibaba для генерации видеороликов, картинок и музыки. Выпущена в феврале 2025 года с открытым исходным кодом под лицензией Apache 2.0. Доступна для бесплатного скачивания на платформах GitHub и HuggingFace. Способна работать онлайн и локально на компьютере.

Что умеет нейросеть

Нейросеть Wan 2.1 ориентирована на выполнение задач мультимодальной генерации. Модель ИИ позволяет:

- Создавать видео по текстовому описанию.

- Редактировать ролики.

- Генерировать аудио для созданных видеозаписей.

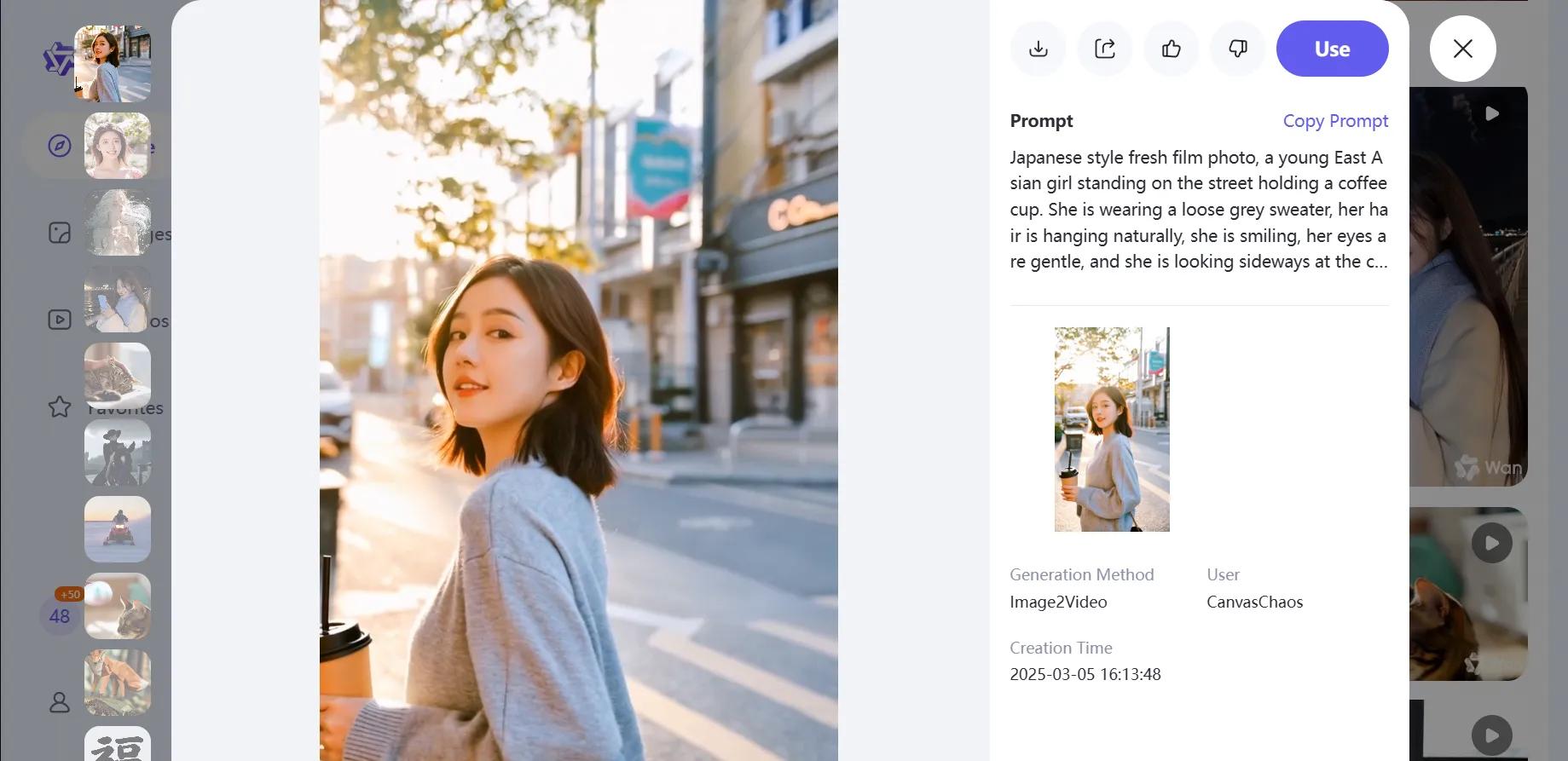

Пользователи отмечают высокое качество генерируемых видеороликов. Модель демонстрирует способность к реалистичному воспроизведению физических эффектов, таких как симуляция движения воды. Качество видео сравнивают с результатами модели Veo 2 от Google, указывая на конкурентоспособность Alibaba Wan 2.1 на рынке генеративных ИИ.

Создание 5-секундного видео в разрешении 480P на NVIDIA RTX 4090 занимает около 4 минут.

Сравнение с конкурентами

Выпуск Comfyui Wan произошел на фоне усиления конкуренции в области искусственного интеллекта в Китае. Основные конкуренты:

- DeepSeek с моделью V3.

- Qwen 2.5-Max от Alibaba – другая модель компании, ориентированная на общее применение ИИ.

Модель доступна для скачивания и интеграции в сторонние проекты через платформы GitHub и HuggingFace. Документация и примеры использования предоставлены разработчиками для упрощения работы с нейросетью. Видеодемонстрации возможностей Wanx публикуются компанией для информирования пользователей о функционале.

Как использовать нейросеть для генерации видео Wan 2.1

Платформа предоставляет ежедневно 50 кредитов бесплатно, Wan 2.1 на русском пока недоступна, но понимает русскоязычные запросы. Поддерживает китайский и английский интерфейс.

Модель ИИ доступна для локальной установки. Wan 2.1 скачать можно с GitHub или HuggingFace. Имеется упрощенная версия T2V-1.3B, совместимая практически с любыми процессорами, для которой требуется 8,19 ГБ VRAM. Нейросеть способна генерировать видео до 5 секунд в качестве 480р.

Также возможно в ближайшем будущем ИИ модель Wan ai video будет добавлена в чат-бот Qwen.

Особенности

- нейросеть создает видео, изображения и аудио по запросу;

- поддерживаемые языки – английский и китайский;

- архитектура включает мощный вариационный автоэнкодер видео-VAE;

- тип лицензии – открытая, Apache 2.0;

- права на использование, изучение, изменение и распространение кода;

- модель ИИ можно скачать бесплатно с GitHub и HuggingFace.

0 комментариев

Пока нет комментариев

Начните обсуждение первым — оно появится здесь сразу после отправки.