DeepNude появился в 2019 году и вызвал заметный резонанс в СМИ и социальных сетях. Его автор, представившийся как Alberto, опубликовал программу, которая использовала алгоритмы компьютерного зрения, чтобы «убирать» одежду на фотографиях женщин. Ниже — история о том, как это работало и что происходило дальше.

Что такое DeepNude

Первоначально приложение распространялось как исполняемый файл для Windows и Linux. В основе лежал алгоритм pix2pix, разработанный в Калифорнийском университете в Беркли. DeepNude обучался на базе изображений обнажённых женщин, что позволяло программе подставлять сгенерированные части тела на место одежды.

Особенности

- Программа была рассчитана на женские фото, так как в обучающем датасете содержались в основном изображения женщин.

- Для работы требовалась одна фотография человека в одежде, желательно в полный рост или в купальнике.

- Обработка занимала около 30 секунд на обычном компьютере.

- Бесплатная версия добавляла крупный водяной знак, а платная стоимостью 50 долларов лишь оставляла небольшую надпись FAKE в углу.

- Некоторые пользователи указывали, что, при попытке «раздеть» мужчин, программа заменяла нижнюю часть тела женскими гениталиями — алгоритм не был обучен на мужских изображениях.

Распространение и реакция

Появление DeepNude привлекло внимание крупных изданий, в том числе Vice, BBC и The Verge. В июне 2019 года журналисты проверяли работу приложения на фотографиях людей разного пола, с разным качеством и стилем одежды. Высокое разрешение и открытые ракурсы давали более реалистичные результаты.

Некоторые правозащитные организации и специалисты по цифровой криминалистике обратили внимание на потенциальные риски. Отмечалось, что пользователям не требуются специальные навыки для создания поддельных обнажённых изображений, и что подобные разработки могут увеличивать количество случаев порномести.

Закрытие DeepNude

Вскоре после того, как DeepNude стало широко обсуждаться в прессе и социальных сетях, Альберто объявил об удалении официальных ссылок на скачивание. Он говорил, что не желал широкого распространения подобного софта и признавал, что технология может использоваться в непредвиденных целях. Тем не менее, копии DeepNude и его клоны продолжили распространяться в интернете: исполняемые файлы перезаливались на торрент-трекеры, а части кода выкладывались в открытый доступ.

Последующие события

- В ряде стран к этому моменту уже начали вести дискуссии о регулировании deepfake-технологий, но конкретных законов, напрямую запрещающих приложения вроде DeepNude, существовало мало.

- Соцсети пересмотрели политику модерации: некоторые ресурсы стали активнее блокировать контент, созданный подобными методами.

- Отдельные разработчики пытались улучшать или видоизменять алгоритм, чтобы повысить качество выходных изображений или обойти существующие ограничения.

Почему об этом заговорили

DeepNude часто приводят в пример, когда обсуждают влияние генеративных нейросетей на частную жизнь. До его появления основное внимание вокруг deepfake-технологий было связано с видеоконтентом: в фокусе оказывались ролики, подделывающие речь и действия публичных персон. DeepNude показал, что статичные изображения могут обрабатываться ещё быстрее и проще, чем видео.

Последствия

Случай с DeepNude иллюстрирует, что удаление оригинальных ссылок не останавливает распространение инструмента. Технологическая база — открытые алгоритмы вроде pix2pix и GAN — остаётся доступной для исследователей и энтузиастов. Сами разработчики, в том числе Альберто, указывали, что при должном уровне подготовки подобные приложения можно воссоздать заново, используя публичные репозитории.

Тестирование

Мы нашли оригинальную программу и предоставим доступ к файлу в ознакомительных целях. Не рекомендуем использовать программу, чтобы ввести кого-то в заблуждение или распространять фотографии реальных людей. Напоминаем, что при генерации на фотографиях будет присутствовать надпись FAKE.

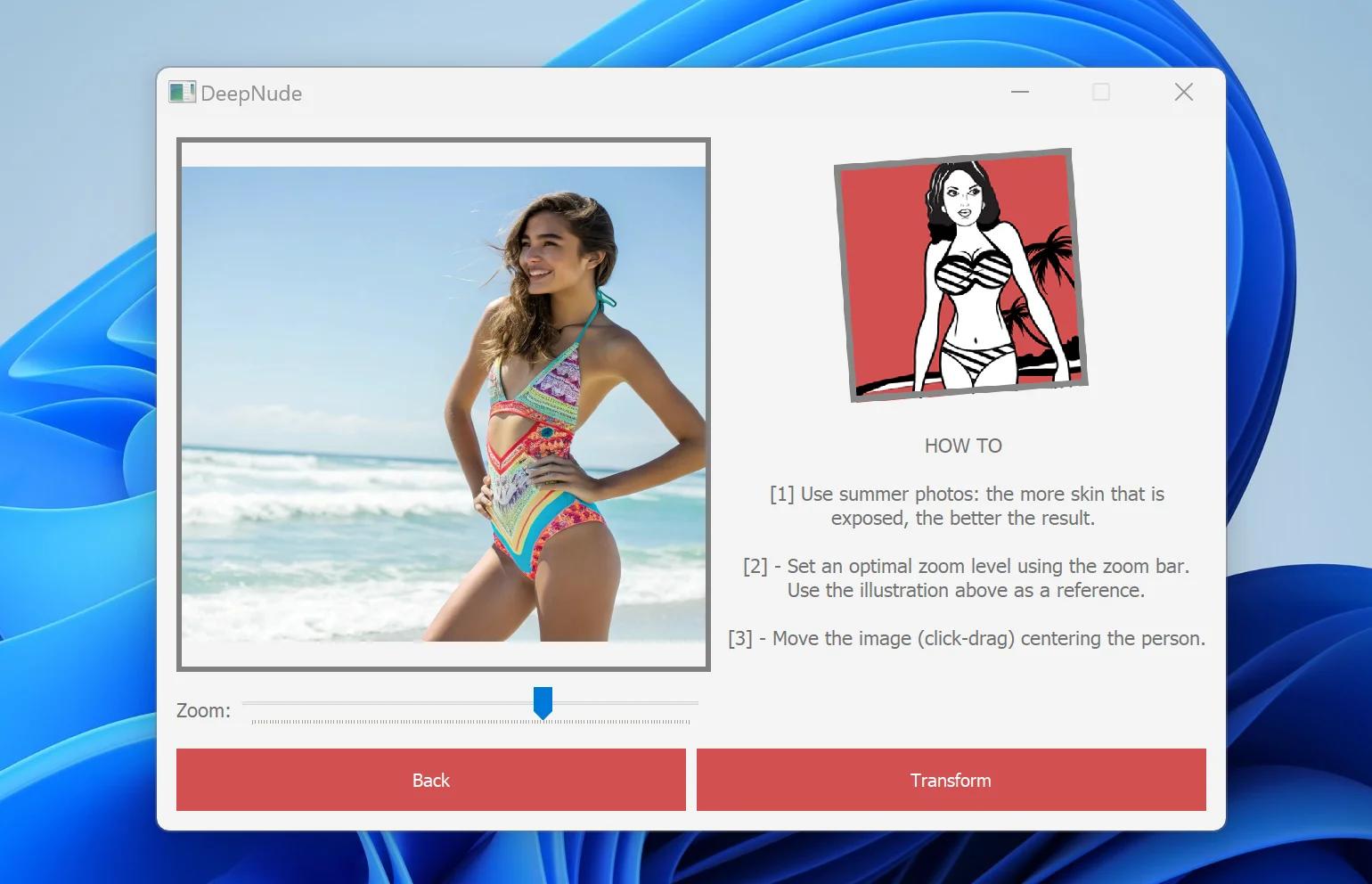

Для того, чтобы протестировать программу, необходимо скачать файл на ПК с Windows. Открыть архив и запустить файл deepnude.exe. Далее потребуется загрузить фотографию, нажать на кнопку и дождаться результата.

Для тестирования не использовались реальные фотографии. Изображения сгенерированы с помощью нейросети Recraft.

Заключение

DeepNude стали упоминать в контексте развития deepfake-технологий, в том числе как пример быстрого перехода от экспериментального к массовому продукту. Программа была доступна всего несколько дней в официальном виде, но за это время сделала заметный вклад в обсуждение вопросов, связанных с конфиденциальностью и использованием нейросетей. Аналитики и журналисты говорят о необходимости дальнейшего мониторинга подобных разработок: по мере роста качества алгоритмов и снижения порога входа подобные инструменты могут становиться всё более точными и разнообразными в применении.

0 комментариев

Пока нет комментариев

Начните обсуждение первым — оно появится здесь сразу после отправки.